Wer kennt das nicht, man schaut sich ein YouTube-Video an und entdeckt etwas Spannendes in der Leiste mit den empfohlenen Videos. Und schon ist der Nachmittag vergangen, dabei wollte man ursprünglich nur ein Lied hören oder eine Rede anschauen. Insgesamt besuchen bis zu 1.5 Milliarde Benutzer monatlich die Videoplattform. Für politische Akteure dementsprechend eine riesige Spielwiese um die Wählerschaft für sich zu gewinnen. Wie es scheint, gehen einige dabei mit zweifelhaften Methoden vor.

Einfluss auf die US-Präsidentschaftswahl 2016

Cambridge Analytica gab an, die Präsidentschaftswahl 2016 für Donald Trump gewonnen zu haben. Daraufhin folgte ein großer Diskurs. Eine neue investigative Recherche des "Guardian" scheint den Einfluss von YouTube auf die Wahl aufzudecken. Dabei konzentrierten sich die Reporter vor allem auf die Weiterempfehlungen von Videos, mithilfe der Insider-Infos eines ehemaligen Mitarbeiters des Konzerns.

Verhalf YouTube Trump zum Präsidenten?

Der französische Programmierer Guillaume Chaslot, der bis 2013 für den Konzern an deren Algorithmus arbeitete, kreierte eine eigene Software, die einen prototypischen Nutzer simuliert. Nach dem eingegebenen Keyword in der Textsuche wandert das Programm entlang der empfohlenen YouTube Videos. 18 Monate lang beobachtete Chaslot den Youtube-Algorithmus und behauptet, einen Zusammenhang zwischen Sensationsvideos und deren Sichtbarkeit zu erkennen. Je aufregender die Geschichte, umso mehr verbreitet sie sich.

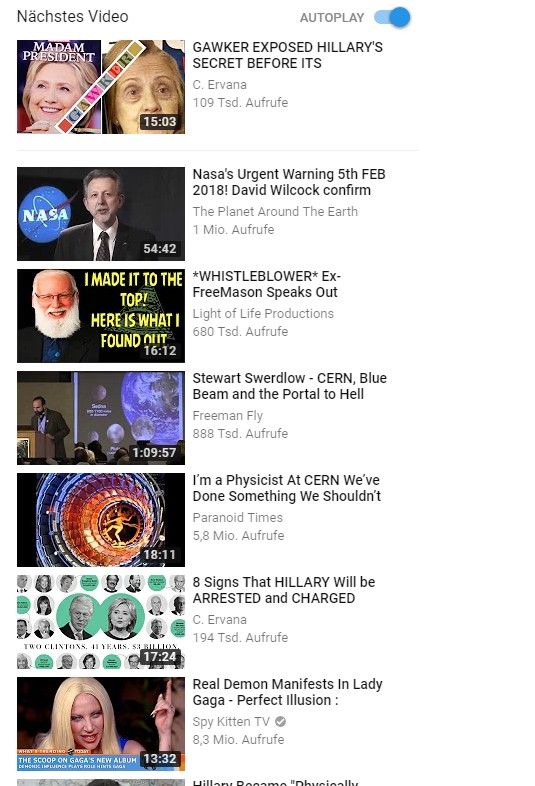

In Zusammenarbeit mit dem Guardian, meint Chaslot ein Muster während der Präsidentschaftswahl in den USA zu erkennen. Dabei sollen Videos, die Trump und seine Aussagen unterstützen, öfter in der Empfehlungsliste gewesen sein, als die der Gegenkandidatin. In einer Datensammlung an empfohlenen Videos zur Textsuche "Trump" oder "Clinton" zwölf Tage vor der Wahl im Jahr 2016, finden sich Videos wie:

und

Aufgrund der Größe der Datenbank konzentrierten sich die Journalisten auf 1000 der am meisten empfohlenen Videos und schauten sich diese detailliert an. Fast ein Drittel der Videos schien neutral den beiden Kandidaten gegenüber zu sein. Von den restlichen 643 Videos favorisierten 551 Donald Trump und nur 92 die Kampagne von Hillary Clinton.

Nach der Veröffentlichung der Recherche warnte der Demokratische Senator Mark Warner vor YouTubes Einfluss aufgrund des Empfehlungs-Algorithmus, da er bestimme, was die Nutzer sehen und somit Platz für die Verbreitung falscher Inhalte biete. Ein Phänomen, das Auslandsnachrichtendienste zu ihrem Vorteil nutzen könnten, laut Warner.

Verbreitung von Verschwörungstheorien

Auch die Verbreitung von Verschwörungstheorien soll durch YouTube und dessen Algorithmus unterstützt werden. Gerade bei dem Attentat in Las Vegas am 1. Oktober 2017, bei dem 58 Menschen ums Leben kamen und fast 500 verletzt wurden, häuften sich die Videos auf der Plattform, die den Vorfall als "blöden Streich" oder alles als "vorgetäuschtes Szenario" bezeichneten. (sem, 10.02.2017)