Sie sehen sich selbst als die Piraten innerhalb von Google, und liefern nun zum zweiten Mal in Folge so etwas wie die inoffizielle, zweite Keynote der I/O. Der Vortrag von Googles ATAP-Abteilung brachte am zweiten Tag der Entwicklerkonferenz jene großen, neuen Ideen die manchen in der eigentlichen Keynote abgegangen waren. "Do some epic shit" bezeichnet Projektleiterin Regina Dugan die eigene Zielsetzung, nur um gleich anzusetzen, dies auch zu belegen.

Neue Wege

Den Anfang machten zwei Projekte, mit denen Google neue Eingabemöglichkeiten jenseits des klassischen Touchscreens zu finden sucht. Sei dieser doch in seinen Möglichkeiten äußerst beschränkt, da sich mit einer fixen Oberfläche viele dem Menschen natürliche Gesten nicht abbilden ließen, argumentiert das Unternehmen. Also forscht ATAP nach neuen Ansätzen. Und die sehen dann etwa so aus.

Project Soli

Mit Project Soli hat man eine Art Mini-Radar in einen kleinen Chip gepackt, der Bewegungen in der Umgebung mit einer Präzision von 10.000 Bildern pro Sekunde erfasst. In einer Live-Demonstration zeigte das Unternehmen denn auch gleich wie genau und schnell das eigene System ist. So werden etwa Drehbewegungen exakt umgesetzt - vorstellen kann man sich das Ganze wie wenn man an einem Regler dreht. In einem anderen Demo war zu sehen, wie eine Uhr über Fingerbewegungen eingestellt wurde, näher am Sensor die Stunden, weiter weg die Minuten.

Der von Google entwickelte Chip soll im Laufe des Jahres veröffentlicht werden. Google will dazu auch gleich offene Programmierschnittstellen liefern, um allen die Entwicklung mit dem Sensor zu erleichtern.

Jacquard

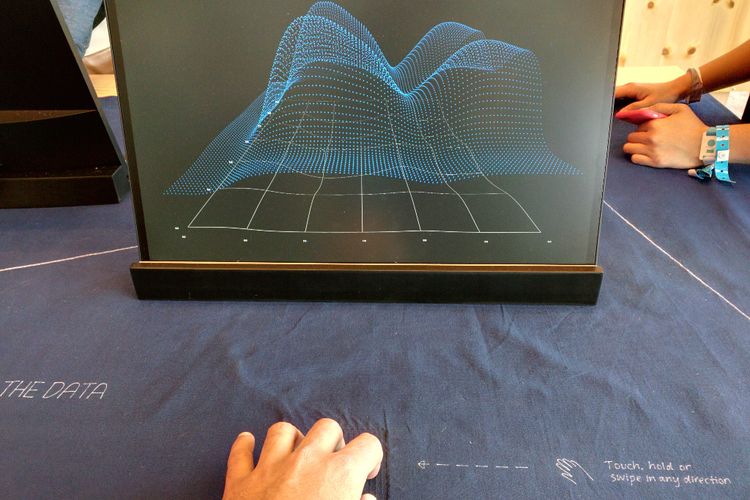

Der Ansatz des Project Jacquard ist wiederum ein vollständig anderer: Es geht darum, interaktive Textilien massentauglich zu machen. Wie sich zeigt, gebe es bisher keinerlei kommerziell erhältlichen Maschinen zur Fertigung, auch sei die technische Qualität enden wollend. Also hat man mit diversen Hersteller zusammengearbeitet, um einen eigenen Garn zu entwickeln.

Dieser sei hundert Mal leitfähiger als bisher verfügbare Fäden, und zudem rein äußerlich nicht mehr von normalem Garn zu unterscheiden. Aus diesem Grundstoff können dann vergleichsweise einfach interaktive Oberflächen gewoben werden. Und zwar mit bestehenden Maschinen und entsprechend kosteneffektiv. Auf der Konferenz konnte der STANDARD dann auch gleich eine Decke ausprobieren, die auf Toucheingaben reagiert, und dabei auch Druck gut wahrnimmt. Andere Demos sind das Regeln von Lichtfarbe und Helligkeit oder die Steuerung des Musik-Players auf einem Smartphone.

Von der Couch

So etwas könne natürlich nie ein vollständiger Ersatz für einen Touchscreen sein, immerhin fehlt hier die grafische Abbildung. Aber für große Gesten sei so etwas hervorragend geeignet, um etwa direkt von der Couch aus ein Gerät zu bedienen - das heimische Sofa könnte also bald auch zur Fernbedienung werden.

Partnerschaft mit Levi's

Doch damit nicht genug, denkt man natürlich auch über die Verwendung der eigenen Fäden in der Kleidungsindustrie nach - und hat sich dafür einen mächtigen Partner geangelt: Den Jeans-Hersteller Levi's. Dass das Bekleidungsunternehmen dieses Engagement durchaus ernst nimmt, unterstrich dabei auch die Anwesenheit von Levi's Brand Präsident James Curleigh.

Abacus

Schon seit einiger Zeit forscht ATAP an Methoden das klassische Passwort abzulösen. Mit Project Abacus gibt es nun ein neues Unterfangen in diese Richtung. Dieses versucht die Identität einer Person über die Kombination mehrerer Faktoren festzustellen. Wie jemand Swipe-Gesten ausführt, wie getippt wird, wie man sich bewegt - alles eindeutige Hinweise, die sicherstellen sollen, dass die Person, die ein Gerät in der Hand hat, auch wirklich die richtige ist. Die Entwicklung dieses Systems erfolgt in Kooperation mit 33 US-Universitäten.

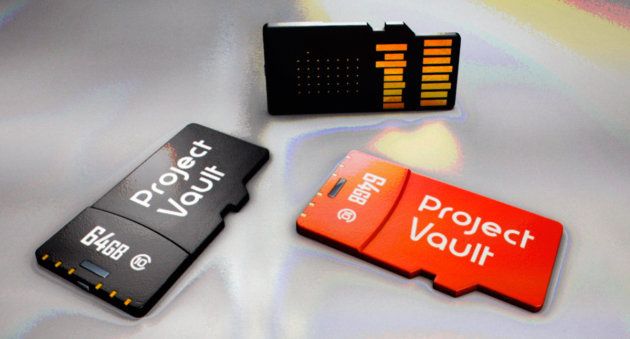

Vault

Es folgte Project Vault: Eine MicroSD-Karte, die man als digitalen Safe bezeichnet. Darin befindet sich ein Mikro-Computer samt ARM-Prozessor, NFC-Chip und 4 GB isoliertem und versiegeltem Speicher. Die Nutzer sollten dies als Hochsicherheitsbereich zum Schutz ihrer eignen Daten ansehen, so Google. Anhand von zwei Prototypen zeigten die Entwickler dann wie ein verschlüsselter Chat abgewickelt wurde. Zumindest zum Start sieht man den Haupteinsatzbereich aber im Unternehmensumfeld und hier vor allem bei der Authentifizierung.

Umsetzung

Im Hintergrund komme dafür starke Kryptopgraphie auf Basis eines extra geschaffenen Echtzeit-Betriebssystems zum Einsatz, versichert Google. Das System sei da bewusst einfach gehalten, um Fehler weitgehend ausschließen zu können. Nach außen liefert die Karte gerade einmal zwei Dateien, über die Kommunikation erfolgt. Dafür werde nicht einmal ein Kernel-Treiber benötigt. Zudem habe dies den Vorteil, dass die Karte mit allen Betriebssystemen funktioniert.

Entwicklung

Fertig ist Project Vault allerdings noch nicht. Als ersten Schritt soll es ein Research Hardware Development Kit geben, eine Entwicklerplatine, die vollständig aus Open-Source-Komponenten gebaut ist - inklusive der CPU (einem OpenRISC 1200-Chip). Dadurch hofft man das Feedback von Sicherheitsexperten und Entwicklern zu erhalten.

Spotlight

ATAP hat aber auch eine künstlerische Ader - und diese offenbart sich in den Spotlight Stories. In den letzten Jahren hat man hier mehrere Filme für das Smartphone veröffentlicht, die den Zusehern die Möglichkeit geben, einen eigenen Blickwinkel einzunehmen, und einen Rundumblick auf das Geschehen zu erhalten. Google sieht darin eine neue Darstellungsform für Filme - und will diese offensiv vorantreiben. So arbeitet man an einem Story Development Kit, das Regisseuren bei der Erstellung eigener Filme helfen soll.

Android und iOS

Zudem will man die Zielgruppe der eigenen Filme erweitern. Waren die Spotlight Stories zunächst auf Motorola-Smartphones beschränkt, sind sie seit wenigen Tagen auch für andere Android-Geräte erhältlich. In Kürze will man auch iOS unterstützen, im Sommer soll dann Youtube solche Filme abspielen können.

Live Action

Waren bisher aller Spotlight Stories animierte Filme, arbeitet man derzeit eifrig am ersten Live-Action-Movie. Dieses wird von Justin Lin, Regisseur des nächsten Star-Trek-Films und mehrerer "The Fast and The Furious"-Teile, gedreht. Auf einem den gesamten Raum umfassenden Bildschirm gab es für die Besucher der Konferenz dann auch gleich einen ersten Trailer zu sehen. Für die Dreharbeiten hat man ein eigenes Kamerasystem aus mehreren Red-Kameras gebastelt.

Ara

Zu guter Letzt gab es noch ein kurzes Update für das modulare Smartphone, Project Ara. Mittlerweile startet dies problemlos, auf der Bühne wurde zudem gezeigt, wie im laufenden Betrieb ein Kameramodul eingesetzt, und umgehend zum Einsatz gebracht wird.

Tango

Am Rande der Konferenz war zudem zu vernehmen, dass Google gemeinsam mit Qualcomm an einem Referenz-Smartphone für Project Tango arbeitet, das also über die Kamera den Raum dreidimensional erfassen kann - eine Art Kinect im Smartphone. Die Bestätigung folgte kurz danach: Das neue Gerät soll einmal mehr als Plattform für Entwickler dienen, und ab dem dritten Quartal verkauft werden. Als Prozessor kommt ein Snapdragon 810 von Qualcomm zum Einsatz. (Andreas Proschofsky aus San Francisco, 30.5.2015)